Por Paula Drummond de Castro

Com pitadas de transgressão, a computação dá suporte à criação e à composição sonora. O instrumento não é mais um objeto passivo, mas algo que também cria respostas, e a ideia é usar as inovações tecnológicas para potencializar os processos criativos.

Se a computação musical artística pudesse ser resumida em uma palavra, seria desconstrução. Desde sua criação, esta linha de pesquisa interdisciplinar – que dialoga com a matemática, computação, e com a composição, análise musical, sonologia – recria novas escutas para o som. Desconstrói e reconstrói, testando os limites do que é a música, do que é a arte. Esta plasticidade abriu possibilidades de recombinações com outras artes, transgredindo as bases da tradição musical clássico-romântica.

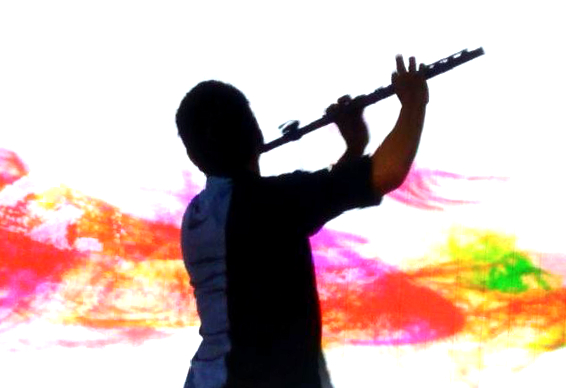

Visualize a cena. O cenário é todo branco. No centro do palco, um músico com uma flauta transversal em posição para tocá-la. Ele começa a dedilhar notas no instrumento e a se movimentar. Instantaneamente, pinceladas projetadas no branco da tela colorem e esmaecem em alguns segundos, em seguida novas pinceladas surgem e esmaecem, à medida que o músico toca. Então, entra um segundo som interagindo com o performer, mas não há outro músico no palco. É seu computador, que aprende instantaneamente com o flautista e interage com ele. O resultado é uma combinação de improvisos, sons, movimentos e cores que torna ilusória qualquer distinção entre ser humano e máquina.

Essa performance foi uma complementação da defesa da tese de doutorado “Metaflauta: uma abordagem ecológica aplicada ao design e processos criativos a partir de um instrumento expandido”, de Gabriel Rimoldi, pelo Instituto de Artes da Unicamp, no final de fevereiro.

Os efeitos audiovisuais executados não são resultados de um espelhamento direto. Existe todo um maquinário, redes de aprendizagem neural para reconhecimento de gestos, movimentos e padrões de movimento que são reconhecidos pelo computador que por sua vez responde com determinadas ações que repercutem tanto no processamento de som quanto de imagem em tempo real. “Eu utilizo a extração de características do som da flauta e uso meu próprio movimento para controlar os processamentos sonoros em tempo real em que o computador interage comigo”, explica Rimoldi.

Na medida em que a máquina incorpora os elementos da performance do instrumentista, ela se torna um agente autônomo. “São mecanismos adaptativos da máquina, nos quais a máquina se ajusta ao meu comportamento enquanto eu toco. Ela aprende comigo. Exploro a ideia de autonomia da máquina”. Rimoldi investiga o que se chama de sistemas interativos com suporte de interfaces digitais musicais e afirma que dedicou mais tempo da tese programando o computador do que propriamente tocando o instrumento.

Stéphan Schaub, pesquisador do Núcleo Interdisciplinar de Comunicação Sonora da Unicamp (NICS) reflete: “A computação musical possibilita inverter a ligação clássica entre o instrumentista e o instrumento. O instrumento não é mais um objeto passivo que o músico vai tocar, mas é um instrumento que vai desenvolver uma resposta qualquer, quase que desenvolver uma consciência, mas como um instrumentista criando respostas próprias”.

“Um instrumento acústico é uma espécie de monobloco rígido que pouco se modifica em relação ao intérprete. O piano está ali e eu, instrumentista, que tenho que me modificar para chegar a uma expressão específica. Já na interface digital musical pode existir uma via bilateral. Eu me modifico em relação ao instrumento e a máquina em relação ao meu comportamento”, complementa o flautista.

A linha investigativa de Rimoldi é apenas um dos caminhos desbravados pelo fecundo encontro entre a música e os avanços tecnológicos. As primeiras tecnologias baseadas em eletricidade e no uso de sinais eletromagnéticos possibilitaram a geração, controle e manipulação do som por meio de suportes elétricos, eletrônicos e, posteriormente, digitais. Com isso, um universo de novas tecnologias tem inspirado criações e pesquisa no campo das artes sonoras. Criou-se uma espécie de “luteria digital”, como definem Rimoldi e seu orientador, Jônatas Manzolli, do NICS/Unicamp. “Para analisar e criar, o pesquisador tem que passar pela luteria. E a luteria é artesanal e parte deste artesanato é programar. Ele se empodera do som à medida que ele domina a relação entre som, pensamento e o modelo”, explica Manzolli.

“No acesso à linguagem de programação e à linguagem musical, nascem coisas fantásticas. Saímos de um paradigma de: se é música, se é matemática, se o computador faz música, se não faz, se é inteligência artificial, se o homem vai ser suplantado pela máquina. Isso é uma linguagem de mercado. Quando se trabalha com a computação musical de forma artística, o que se quer é usar uma ferramenta muito poderosa para um processo criativo que pode ser potencializado”, analisa Manzolli.

Um dos desafios desse campo é olhar o som de uma forma nova. Ir para dentro do som. Como explica Manzolli, “o computador é quase um microscópio do som. Mergulha-se no som em nuances que praticamente não se pode ouvir, mas que talvez não possa ser visualizado ou não se tem um controle fino disso. Isso é um ganho muito poderoso”.

Um dos pilares importantes para a institucionalização desse campo de estudo no país foi o reconhecimento e a criação da área de sonologia. Esta área não é computação musical, mas se beneficia das ferramentas da computação musical e, sobretudo, traz centralidade para o pensamento musical orientado para o som, que vai além das possibilidades da música baseada em notas musicais ou, ainda, uma música que é som. Essa sutileza de interpretação fez avançar tanto o processo criativo quanto a análise musical. “A sonologia abriu espaço para essa investigação e dois vetores epistêmicos de pesquisa se posicionaram: o processo criativo com suporte computacional e a análise musical com suporte computacional. São disciplinas que se colaboram, mas com certa autonomia”, elucida Manzolli.

Dos tataravós dos DJs aos “grãos musicais”

Música eletroacústica foi uma das primeiras músicas sem instrumentos. Os materiais sonoros desse gênero musical são trabalhados por meio de sintetizadores, gravadores, mixers, computadores, softwares, entre outros equipamentos eletrônicos e na qual o compositor é simultaneamente o próprio intérprete das suas obras, utilizando técnicas das quais não cabe a escrita convencional por partitura.

Inspira-se na música acusmática, a “música de autofalantes”. Esse conceito adveio de uma prática dos discípulos do filósofo grego Pitágoras, que ouviam separados dele por uma cortina. O propósito era que a imagem do mestre não prevalecesse sobre a preleção e, assim, orientando seus alunos a se concentrar na fala do professor. “A música acusmática resgata esses valores de se escutar o som sem que o apreciador se apegue à imagem do emissor” destaca José Henrique Padovani, professor da Universidade Federal de Minas Gerais.

Entre os pioneiros desse estilo de música está o francês, Pierre Schaeffer (1910-1995), da Rádio Nacional da França, um dos criadores da música concreta nas décadas de 1940-1950. Trata-se de música eletroacústica produzida a partir de edição de áudio unida a fragmentos de sons naturais e/ou industriais (como o de baldes, ou serras elétricas, por exemplo). Shaeffer gravava, recortava e fazia bricolagens de fita magnética criando músicas sem partituras. Esse tipo de música realça os aspectos estruturais do som.

Outra referência é o Estúdio de Colônia (Alemanha), com Karlheinz Stockhausen (1928-2007), o primeiro compositor de música a partir de sintetizadores, sons sintéticos. As suas obras revolucionaram a percepção de ritmo, melodia e harmonia. Nas suas primeiras pesquisas em torno da música eletrônica, Stockhausen analisou as potencialidades dos sons sintéticos e criou novos timbres utilizando equipamentos e aparelhos de síntese.

A partir da década de 1960, as experimentações avançaram no instrumento criando a ideia de instrumento expandido, aquele que explora os ruídos dos instrumentos, ou outras possibilidades, na música instrumental. Na busca de uma paleta de ruídos, de sons, de repertórios. E trazendo complexidade à divisão do que é natural ou artificial no campo da produção sonora.

Essas influências são referências para desconstruir a ideia clássica, erudita e convencional de música, além de gerar provocações sobre as definições do que se encaixa em arte sonora. “Schaeffer e Stockhausen podem ser considerados os tataravós dos DJs, da música eletrônica, da techno, do hip-hop” compara Rimoldi. Entretanto, “como uma prática relativamente hermética, acabou não ganhando popularidade” complementa Padovani.

Mas foi na década de 1980 que houve um verdadeiro crescimento da computação musical. Em parte pela criação dos computadores pessoais que facilitaram enormemente o acesso a essa tecnologia. Essa década é marcada pelo boom das interfaces gestuais, combinações de movimentos e gestos para gerar som. “Mas a técnica de síntese, ou seja, pegar o som, recortar em pequenos pedacinhos de ‘grãos musicais’ e reuni-los de acordo com um modelo, ainda persiste, só que na década de 1950 era mecânico. Hoje fazemos de maneira digital, mas seguindo os mesmos preceitos”, elucida Rimoldi.

E se o piano falasse?

“O som é algo extremamente complexo, rico em informações. A ideia é de que um descritor de áudio consiga extrair um aspecto deste som, por exemplo, da intensidade” explana Stéphan Schaub.

Esses elementos abrem uma ampla área de estudo na computação musical, que permitem descrever e recriar sons que existem. Estes descritores de áudio podem ser comparados em diferentes dimensões de análise, um campo muito fértil para a análise e criação com suporte computacional. Um exemplo é comparar uma determinada paleta de sons, como por exemplo uma fala, como a de uma orquestra instrumental. “O programa procura, por meio de um algoritmo genético, quais conjuntos (ou combinações) de sons orquestrais mais se parecem com o proposto”, explica Schaub. Jonathan Harvey (1939 -2012), compositor britânico que usou balbucios e choros de bebês juntamente com a fala humana e “substituiu” por sons de instrumentos de orquestra, e o resultado é a consagrada obra “Speakings” (2007/2008), na qual ele “dá voz a uma orquestra”. Este é um caso em que o compositor usa o computador como suporte, mas o produto final não tem computador envolvido necessariamente.

Essa linha de pesquisa está relacionada com os campos de music information retrival e de machine listening, a escuta de máquina. A ideia desse tipo de pesquisa é utilizar o computador para encontrar, dentro de um banco de amostras sonoras, informações simbólicas, por exemplo altura fundamental, harmonia, notas, qual a complexidade do espectro, atributos sonoros relacionados à identificação de ruídos ou notas definidas e, ainda, a análise de características sonoras relacionadas à voz, como o reconhecimento de fonemas, consoantes e vogais. “É possível utilizar as informações sonoras da voz para manipulação de um instrumento musical. Imagina que eu consiga fazer um piano pronunciar uma palavra? Que o som de um piano passe a ter uma qualidade sonora que a gente normalmente associa à voz e à dicção” especula Padovani.

Essa forma de analisar sons teve como resultados, tecnológicos e comerciais, os algoritmos que selecionam preferências e indicam sugestões musicais em aplicativos de música, por exemplo. Esses programas utilizam descritores de áudio combinados com outros algoritmos de aprendizado de máquina para identificar as características das músicas do ouvinte e buscar outras músicas com características semelhantes.

– Traga-me a harpa de ouro!

“E ela, como sempre fazia, obedeceu-lhe prontamente. O gigante esperou que ela se retirasse para dormir, depois colocou o instrumento sobre a mesa e ordenou:

— Toque!

No mesmo instante, a harpa de ouro começou a tocar sozinha uma melodia doce e suave, que deixou João maravilhado e que embalou os sonhos do malvado gigante”. João e o pé de feijão (Fábula dos Irmãos Grimm).

Automatizar instrumentos é uma ideia antiga e já está no imaginário popular há muitos anos. Um exemplo é a harpa encantada do gigante da história do João e o pé de feijão, dos irmãos Grimm, que tocava sozinha.

Leonardo da Vinci também experimentou instrumentos mecânicos que automatizam processos de tambores. A pianola, também chamada piano mecânico, é um piano que executa músicas automaticamente, por meio de mecanismos pneumáticos ou eletromecânicos que o operam por meio de rolos de pianola, que são feitos de papel perfurado ou de metal. “A fantasia de que haverá máquinas que vão replicar habilidades humanas é bem antiga”, pondera Tiago Tavares, professor na Faculdade de Engenharia Elétrica e de Computação da Unicamp, e idealizador da orquestra de berimbaus robôs.

Uma busca rápida do “Google instrumentos robotizados” traz uma longa lista de robôs que tocam piano, bateria, marimba, violino, e outros. Uns são os mais rápidos do mundo para tocar, outros improvisam. As motivações que orientam seus desenvolvimentos são variadas.

A orquestra de berimbaus robôs da Unicamp é formada por quatro instrumentos robotizados, com vários apetrechos ligados ao instrumento em um design totalmente reprodutível. “A orquestra é inteiramente reprodutível com materiais que podem ser comprados no Brasil, com um Arduino e software aberto”, explica Tavares. O código fonte para saber como tudo foi feito está aqui e o projeto foi desenvolvido com colaboração do professor Rafael Ferrari e mais seis alunos.

A motivação para desenvolver berimbaus robotizados não é fazê-los tocar tal qual um ser humano o faria. “O melhor berimbau robô possível ficará pior do que um ser humano tocando, pois não há expressividade. Estamos indo por um caminho de desenvolver um robô que toca coisas que um ser humano não conseguiria em princípio. Será que queremos que ele toque com várias baquetas? Ou colocar um arco de violino? Associar a uma paleta de sons? Por que só uma pedra? E se a pedra deslizar? Por que pedra? A função é dar uma nova perspectiva artística” especula Tavares.

Certamente a resposta unânime dos pesquisadores e artistas da computação musical para as questões colocadas por Tavares seria “E por que não?”.

Veja também:

Software livre de análise com suporte computacional

Sonic Visualiser

EAnalysis

Centros de referência

Grupo de Representações Musicais do IRCAM

Centre for interdisciplinary research in music media and technology

Center for computer research in music and acoustics

Paula Drummond de Castro é formada em ciências biológicas (Unicamp), com mestrado e doutorado em política científica e tecnológica (Unicamp). Pesquisadora associada do Geopi (Grupo de Estudos da Organização da Pesquisa e da Inovação). Atualmente é aluna do curso de especialização em jornalismo científico (Labjor/Unicamp).